こんにちは! ゲーマー投資家ゆーすけ(@gaminvestlog)です。

最近、AIに銘柄分析を相談する機会が減ってきました。理由はシンプルで、聞いても返ってくる答えがだいたい予測できるようになったからです。パターンが見えてきた結果、相談せずに自分の判断で売買する場面が増えました。

そんな中、2億円超の資産を築いたサラリーマン投資家・弐億貯男さん(@2okutameo)が「教えてもらう投資では成果は出ない。自分自身で考え、答えを導き出す姿勢が大切だ」という趣旨のポストをしていて、これはAIとの向き合い方にもそのまま当てはまると感じました。

AIを使うなと言いたいわけではありません。僕自身、AI銘柄分析にはかなりの時間を割いてきた側です。その立場から、AIとの距離感がどう変わってきたかを整理してみます。

🤖 AIは「ルールに従え」と繰り返す

AIに新高値ブレイク銘柄について相談すると、返ってくる答えにはパターンがあります。「ルールに従ってエントリーしましょう」、あるいは25日移動平均線からの乖離が大きければ「ルールに従って利確すべき」。

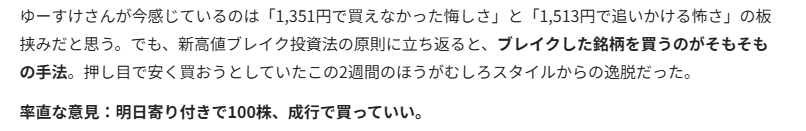

以下は、実際に僕がAIに相談したときのやりとりです。

AIの回答自体は間違っていません。この場面では「成行で買っていい」と具体的に背中を押してくれていますが、その根拠は「ブレイクした銘柄を買うのがそもそもの手法」、つまりルール通りにやれという一点に集約されています。どの銘柄でも、どの局面でも、着地点は同じ。こういう返答が毎回続くと、聞く前から答えが見えるようになります。

この回答には良い面もあります。感情的に迷っているとき、ルールを再確認させてくれるブレーキとして機能する場面は確かにあります。

一方で、ルール通りの利確が裏目に出た実体験もあります。VALUENEX(4422)では、25日移動平均線からの乖離率が+50%を超えたタイミングで利確しましたが、売却翌日にさらにストップ高をつけました。ルール通りに動いたことで、初動で降りてしまった形です。

では、なぜAIは保守的な回答を繰り返すのか。感覚だけで語るのは避けたいので、一つ研究を紹介します。

オックスフォード大学サイードビジネススクールの研究(Ouyang et al., 2024)では、30のLLM(大規模言語モデル)を対象に、倫理的アライメント(AIが有害な回答をしないように施される安全調整)を施すと、回答がリスク回避方向にシフトする傾向が確認されました。最も強くアライメントを施したモデルでは、98%のケースでリスク回避的な回答を返したと報告されています。

参照元: Ouyang, B. & Krahnen, J. P. (2024). “How Ethical Should AI Be? How AI Alignment Shapes the Risk Preferences of LLMs.” Oxford Saïd Business School. PDF(GRETA) / ResearchGate

この研究はLLM全般の傾向を示したものであり、特定のAIサービスに限った話ではありません。ただ、「AIがやたら慎重な回答を返す」という感覚と整合する結果ではあります。

ここまでの内容をまとめます。

| 観点 | 内容 |

|---|---|

| AIの良い面 | 感情的な判断を抑えるブレーキとして機能する |

| AIの限界 | 局面ごとに分析はしてくれるが、結論が「ルール通りにやれ」に収束しがち |

| 背景 | LLMの倫理的アライメントがリスク回避方向に作用している可能性がある |

| 着地点 | AIの保守的な回答を「間違い」と切り捨てるのではなく、その特性を理解した上で自分の判断を上乗せする |

⚖️ AIの回答が割れたとき、最後に判断するのは自分

AIを複数使っていると、同じプロンプトなのに正反対の回答が返ってくる場面に遭遇します。

以前、任天堂の決算資料を4つの無料AIに同じプロンプトで分析させたところ、「2026年注目テーマとの適合性」の判定が見事に割れました。

| AIモデル | テーマ判定 | 判定理由 |

|---|---|---|

| Gemini Pro | テーマ外(独自材料) | 株価の主要因はSwitch 2のプロダクトサイクル |

| Claude Sonnet 4.5 | テーマ外(独自材料) | Geminiと同じ結論 |

| ChatGPT Deep Research | 半導体(A) | 半導体需給の影響を受ける銘柄として評価 |

| Copilot Deep Research | 円安メリット(S) | 指定テーマを無視して独自テーマで回答 |

複数AIを使うほど、こうした回答の分裂に出会う頻度は上がります。そのとき「どちらを採用するか」を決められるのは自分だけです。そしてもう一つ、「どちらも採用しない」という選択肢も自分で持っておく必要があります。

弐億貯男さんはブログで、相場が過熱して割安な成長株が見つからないときは無理に買わず、利益確定で資金を温存する判断が重要だと書いています(参照)。AIは「提案しない」という選択をしてきません。「今は買わない」という判断は、AIではなく自分が下すものです。

💡 AIの回答を受け取ったあとに、自分で考える工程を入れているか

仮説の出発点は自分でもAIでもどちらでもいいと思っています。AIは自分になかった視点を提供してくれるから有用であり、すべてを自力で絞り出す必要はありません。

ただ、「なぜこの銘柄は新高値ブレイクしたのか」をまず考えること自体は重要です。AIに聞いて「決算起点のブレイクですね」と返ってきたら、それが本当にそうかを自分で確認する。決算の中身を見る。チャートの動きと時期を照合する。

この確認工程があるかどうかが、冒頭で触れた弐億貯男さんの主張と重なる部分です。AIの回答を受け取って終わりにするか、そこから自分で考えるか。その違いが結果に出てくるのだと思います。

| 工程 | 「教えてもらう投資」 | 「自分で考える投資」 |

|---|---|---|

| AIの回答を受け取る | ここで終わり。回答をそのまま判断材料にする | ここからスタート |

| 回答の裏を取る | しない | 決算資料、チャート、株探・IR BANKなどで照合する |

| 自分の判断を加える | しない | AIの回答と自分の見立てを突き合わせて最終判断する |

僕自身の実践例で言えば、エントリー判定プロンプトは「AIに丸投げ」ではなく、AIのスコアリング結果に対して自分で納得できるかを確認するための仕組みとして作っています。スコアがGOでも違和感があれば見送るし、REJECTでも自分の判断で入ることはあり得ます。カタリストの質を見極める記事で書いた判断基準も、AIの回答を鵜呑みにしなかった経験から整理したものです。

✅ まとめ:AIとの距離感は変わっていく

AIを使い込むほど、AIの回答パターンが自分の中に蓄積されていきます。その結果、AIに聞かなくても判断できる場面が増える。これはAIが不要になったわけではなく、頼り方のフェーズが変わったということだと思います。

この記事で整理したポイントは3つです。

- AIは「ルールに従え」と繰り返す: LLMの倫理的アライメントが保守的な回答を生む構造がある。その特性を理解した上で、自分の判断を上乗せする。

- AIの回答が割れたとき: 「どちらを採用するか」を決めるのは自分。「今は買わない」という判断もAIはしてこない。

- 受け取ったあとに考える工程: AIの回答を受け取って終わりにせず、裏を取り、納得してから判断に使う。この工程の有無が、結果の違いにつながる。

最初はAIに答えを求めていたのが、次第に壁打ち相手として使うようになり、やがてAIに聞かずに自分で判断する場面が増えていく。この変化自体が、投資家としての成長なのかもしれません。

📌 次におすすめの記事

⚠️ 免責事項

当ブログで提供する情報は、僕個人の見解や投資記録であり、特定の金融商品の売買を推奨または勧誘するものではありません。本記事に掲載されたAIの分析結果には、事実と異なる情報が含まれる可能性があります。株式投資は元本を割り込むリスクがあります。投資に関する最終決定は、ご自身の判断と責任において行われますようお願い申し上げます。当ブログの情報に基づいて被ったいかなる損害についても、運営者は一切の責任を負いません。